저비용 웹캠으로 작동하는 완전 오픈소스 모션캡처 'FreeMoCap' 소개. 하드·소프트웨어 비종속적이며 연구급 성능을 최소비용으로 제공해 분산형 과학 연구, 교육, 훈련에 활용 가능. 소스와 설치 가이드는 GitHub에 공개. 주간 로봇·AI 인사이트 구독 링크 포함.

#mocap

Ilir Aliu (@IlirAliu_)

저가형 웹캠으로 동작하는 완전 오픈소스 모션 캡처 시스템 'The FreeMoCap Project'를 소개함. 하드웨어·소프트웨어 비종속적이며 저비용·연구급 품질을 목표로 하는 분산 과학 연구, 교육 및 훈련용 모션캡처 플랫폼 프로젝트임.

Marcel (@onlyMarcelM)

@levelsio의 PhotoAI MOCAP 기능을 사용해 원본 영상과 AI로 생성한 영상을 글리치로 교차 전환하는 자동 영상 효과를 구상·구현한 사례. 글리치로 AI 효과를 '드러내는' 표현을 위해 스크립트를 직접 코딩해 시연한 창의적 응용 사례임.

el.cine (@EHuanglu)

AI 기반 모션 캡처가 VFX 분야를 빠르게 바꾸고 있다는 내용입니다. 신체 동작·표정·입 모양을 빠르게 복사해 다른 배우에게 적용할 수 있고, 배경·의상·외형 등 씬의 요소도 편집 가능하며, 5분 만에 처리하는 워크플로우를 소개한다고 주장합니다. VFX 작업의 자동화·생산성 향상 사례입니다.

Done using CEB HubMocap (PromptHMR module)

Download at

https://github.com/carlosedubarreto/ceb_hubmocap/releases

Environment done using for the GS

https://superhivemarket.com/products/3dgs-render-by-kiri-engine?ref=1134

And HDRI Maker to the background Dome

https://superhivemarket.com/products/hdri-maker?ref=1134

Video reference

https://www.youtube.com/watch?v=FWdBvxCXFII

Anyone have any FOSS mocap software that they've used in a Blender workflow and recommend?

I'm running a Linux workstation.

I know there's a lot of options but I'd like some second opinions before I try to dig in to a few of these.

The intended goal is ultimately an animated short.

Продолжаю генерить анимированные позы на основе китайской аэробики

(я, реально, так и не нашёл никакого лучше варианта, чем китайская аэробика, потому что там, как правило, 2 и 3 персонажа, и персонажа справа как раз можно вырезать и на ней и генерить позы)

Пока генерил, обнаружил парочку новых подводных камней:

- НИКОГДА не надо растягивать видео больше, чем на 50%!!! Это, прям, вот, очень важно!!! А то нейронку мандраж хватать начнёт, и она начёт отдельные кадры при захвате пропускать!!! А лечить это потом больно и долго!!!

- НИКОГДА не надо захватывать движения в нейронке с персонажа в жёлтой майке на фоне заката или в зелёной майке на фоне моря!!! От этого тоже куча пропущенных кадров генерируется, и это тоже долго и больно лечить!!! Персонаж для захвата должен быть одетым в одежду контрастного с фоном цвета!!! (в принципе, фон можно и другой нейронкой вырезать, правда, я пока что не понял, какой)

#generativeai #comfyui #mocap #china #fitness

Here is an example of why I say "it depends" when someone asks what is the best monocular mocap solution.

Most would say that PromptHMR is the best one today. Is it?

I was just giving a try on a video and turns out, that, in my opinion

1º- 4d humans

2º- GVHMR

3º- PromptHMR

But this is a fast acrobatic video. Looks like for unusual movements, 4d humans works better.

#b3d #mocap

Video created using CEB Hubmocap PromptHMR and Hamer for hands

https://github.com/carlosedubarreto/ceb_hubmocap/releases

Environment done using HDRI Maker

https://superhivemarket.com/products/hdri-maker?ref=1134

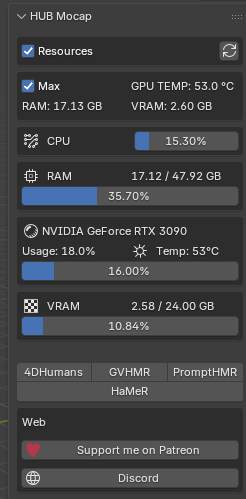

CEB Hubmocap 0.08 released.

Now there is a resource monitor to check the system status (its off by default)

A fix on hamer, where it was having problem when you didnt have hands detected since the start of the video

https://github.com/carlosedubarreto/ceb_hubmocap/releases/tag/v0.08

#b3d #mocap

GVHMRi просто прекрасно работает

Да, медленно, 30 секунд видео она около часа обрабатывает (минут ~30 на экстракт поз и минут ~30 на сборку в SMPL),

но, да,

результат окупает издержки

НО... всё бы ничего, да вот в DAZ STUDIO позы нормально НЕ РАБОТАЮТ:

модель всё равно клинит и болтает во все стороны, хотя в VRoid и MMD всё вообще отлично: даже плавность, наконец-то, появилась (небольшой люфт по осям сохраняется, но не критично - подровняю потом, если мешать начнёт...)

В общем, буду кляньчить у товарища Маска Илоновича Грока решение проблемы с D|S, а так рабочий поток налажен - уже текучка пошла...

(проблемы с D|S не критичны, ибо я МоКап под MMD поднимал, но, да, есть один проект и для дазовских прог'... Причём, ощущение такое, будто во всём виновата их внутренняя система кинематики)

#generativeai #comfyui #ViTPose #GVHMRinference #MoCap

Наконец, MMD!

(то, ради чего всё и затевалось, собcтвенн@)

Ну, как бы уже без комментариев с моей стороны, да?..

Короче, запускаю следующую генерацию из других танцевальных видео,

а сам пока проконсультируюсь с Гроком по-поводу того, как чинить эти движения зомби и упырей...

Повторюсь, что принимаю любые полезные советы!! Мне важно ваше мнение, я в этой теме всерьёз и до полусмерти!!

#mmd #anime #game #bvh #mocap

Я, наконец-то, собрал воркфлоу для ComfyUI для МокАпа

Скачал чужое танцевальное видео и захватил движения из него

ЭТО БЫЛО БОЛЬНО И ТЯЖЕЛО, но, кажется, мы справились..?

Видео примеры - далее, но сначала - скриншот самого рабочего потока:

(Я не спец по нейронкам, и это не окончательный вариант - у меня сейчас какие-то глюки сразу в 3 приложениях с готовым BVH файлом, поэтому принимаю любые полезные советы по улучшению рабочего потока!!!)

#generativeai #comfyui #motioncapture #mocap #nvidia